Imagens produzidas por inteligência artificial (IA) conseguem enganar até quem conhece bem os rostos retratados. A conclusão é de uma pesquisa conduzida pelas universidades de Swansea e Lincoln, no Reino Unido, e pela Universidade Ariel, em Israel.

Como o estudo foi conduzido

Os pesquisadores utilizaram os modelos ChatGPT e DALL-E para gerar retratos sintéticos de pessoas famosas e fictícias. Em quatro experimentos subsequentes, voluntários precisaram apontar quais imagens eram autênticas e quais haviam sido produzidas por IA. A inclusão de fotos de comparação ou a familiaridade prévia com os rostos praticamente não melhorou o desempenho dos participantes.

Testes internacionais

Em um dos ensaios, pessoas dos Estados Unidos, Canadá, Reino Unido, Austrália e Nova Zelândia receberam uma série de fotografias reais e artificiais. A maioria errou nas escolhas. Outro experimento apresentou versões digitais de atores de Hollywood, como Paul Rudd e Olivia Wilde, gerando novamente alto nível de confusão.

Perigos dos deepfakes

A equipe lembra que a mesma tecnologia que cria arte ou aprimora efeitos visuais também facilita fraudes visuais. Entre os riscos apontados estão o uso de imagens falsas para campanhas de desinformação, suposto apoio de celebridades a produtos ou figuras políticas e o enfraquecimento da confiança em registros jornalísticos.

Alerta dos pesquisadores

Jeremy Tree, da Escola de Psicologia da Universidade de Swansea, afirmou que nem a familiaridade com o rosto nem imagens de referência ajudaram substancialmente na detecção das falsificações, reforçando a necessidade de novos métodos automáticos de verificação. Até que essas ferramentas fiquem prontas, orienta-se cautela diante de imagens “perfeitas demais”.

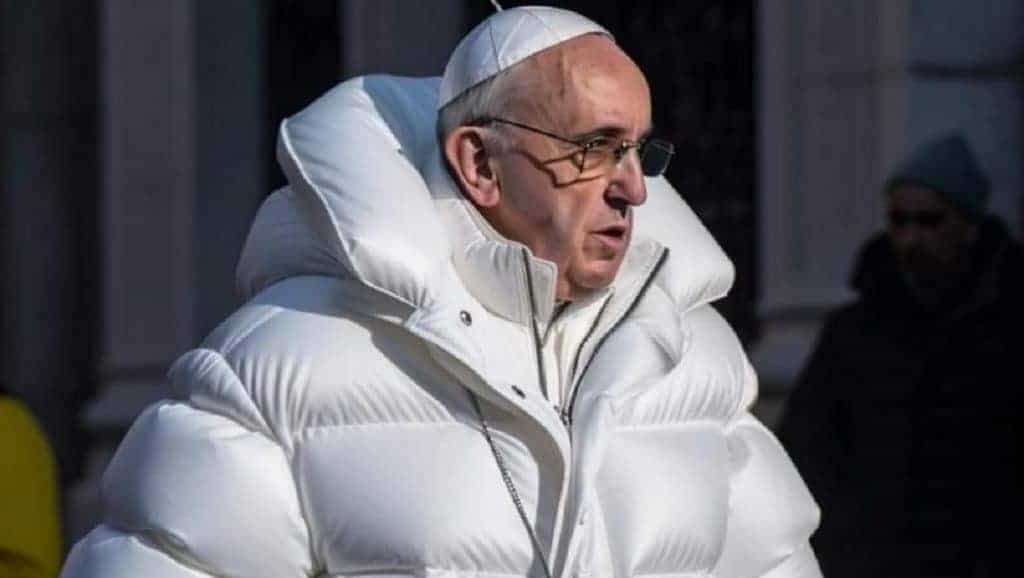

Imagem: Reprodução

O estudo soma-se a recentes casos de deepfakes que ganharam as redes, como a imagem do Papa Francisco usando um casaco de grife em 2023, e amplia o debate sobre a autenticidade de conteúdo visual na era digital.

Com informações de Olhar Digital