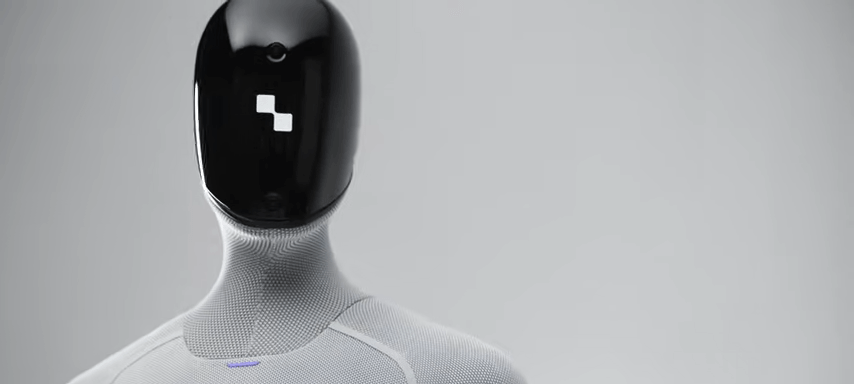

Figure AI é acusada de ignorar riscos em robô humanoide

Figure AI enfrenta uma ação judicial movida pelo ex-chefe de segurança Robert Gruendel, que alega que os robôs humanoides da startup têm força suficiente para causar ferimentos graves, inclusive fraturar crânios, e que seus alertas internos foram ignorados.

Ex-funcionário relata testes alarmantes

De acordo com os documentos protocolados na Justiça da Califórnia, Gruendel afirma que, durante ensaios internos, a mão de um protótipo aplicou pressão capaz de quebrar um crânio humano. Em outro experimento, o braço do robô teria cortado cerca de 0,6 centímetro de uma porta de geladeira de aço, demonstrando potencial de dano em contato com superfícies rígidas.

O ex-executivo sustenta que solicitou limites de força mais rígidos, sistemas adicionais de parada de emergência e revisão dos sensores, mas a liderança teria tratado seus alertas como obstáculos ao cronograma de demonstrações públicas e captação de novos aportes.

Acusações sobre comunicação com investidores

Gruendel também aponta suposta suavização de um roadmap de segurança apresentado a investidores. Segundo ele, o material original detalhava riscos e etapas de mitigação, mas teria sido condensado antes da rodada que elevou a empresa a uma avaliação próxima de € 39 bilhões, financiada por nomes como Jeff Bezos, Microsoft e NVIDIA.

Em nota oficial, a Figure AI nega todas as acusações, atribuindo a demissão do ex-chefe de segurança a “desempenho abaixo do esperado” e reafirmando “compromisso absoluto com a segurança”. A companhia afirma que contestará o processo ponto a ponto.

Imagem: William R

Mercado bilionário aumenta pressão

Relatórios como o do Morgan Stanley projetam que o mercado de robôs humanoides pode movimentar dezenas de bilhões de dólares até 2030. A Figure AI, por exemplo, planeja entregar 200 mil unidades até 2029 e faturar mais de € 9 bilhões com contratos em fábricas e armazéns. Especialistas ouvidos pelo The Verge alertam que, quanto maior a escala, maior a necessidade de protocolos robustos para proteger operadores humanos.

Resta ao tribunal decidir se a startup priorizou crescimento acelerado em detrimento da segurança. Enquanto isso, a denúncia reacende o debate sobre como equilibrar inovação e responsabilidade em robótica.

Quer acompanhar outras discussões quentes do mundo tech? Visite nossa editoria de tecnologia e fique por dentro das últimas novidades.

Crédito da imagem: Hardware.com.br Fonte: Hardware.com.br